「従業員がChatGPTを使い始めているが、社内ルールがない」「生成AIのガイドラインを作りたいが何を盛り込むべきかわからない」という企業担当者が急増しています。本記事では、生成AIガイドラインの策定に必要な全要素を、テンプレート付きで実践的に解説します。

なぜ今、生成AIガイドラインが必要なのか

2023年以降、日本の企業・組織でChatGPTなどの生成AIの業務活用が急拡大しています。しかし生成AI 社内ルールが未整備のまま活用が広がると、以下のリスクが顕在化します。

- 機密情報・顧客情報がAIサービス事業者のサーバーに送信される情報漏洩

- AI生成コンテンツの著作権侵害による法的リスク

- ハルシネーション(誤情報)を事実として使用した意思決定ミス

- 部門・個人によってバラバラなツール利用による管理不能状態

生成AIリスクの全体像については生成AIリスク完全ガイドをご覧ください。

生成AIガイドライン策定の5ステップ

実効性のある生成AIガイドラインを策定するための5ステップを解説します。

ステップ1:現状調査(AI利用の実態把握)

まず社内でどのようにAIが使われているかを調査します。多くの企業で、ガイドライン策定前から従業員がAIを使い始めているため、現状把握が先決です。

【現状調査チェックシート】

□ 利用されているAIツールの種類(ChatGPT/Claude/Gemini/Copilot等)

□ 利用している部門・職種・人数の把握

□ 主な利用目的(文書作成/コード生成/翻訳/分析等)

□ 個人アカウント/会社提供ツールの区別

□ 機密情報・個人情報の入力有無の確認

□ AI利用によるトラブルの有無ステップ2:リスク評価

自社の業種・業態に応じたリスク評価を実施します。医療・金融・法律など規制業種ではリスクレベルが高く、より厳格なガイドラインが必要です。

ステップ3:ガイドライン案の策定

法務・情報システム・人事・各部門の代表が参加するワーキンググループを組成し、ガイドライン案を策定します。

ステップ4:経営承認・全社周知

経営層の承認を得ることで、ガイドラインの実効性が高まります。全従業員への周知・研修も同時に実施します。

ステップ5:定期的な見直し

AI技術と規制環境は急速に変化します。最低でも6ヶ月に一度の定期見直しを計画に組み込んでください。

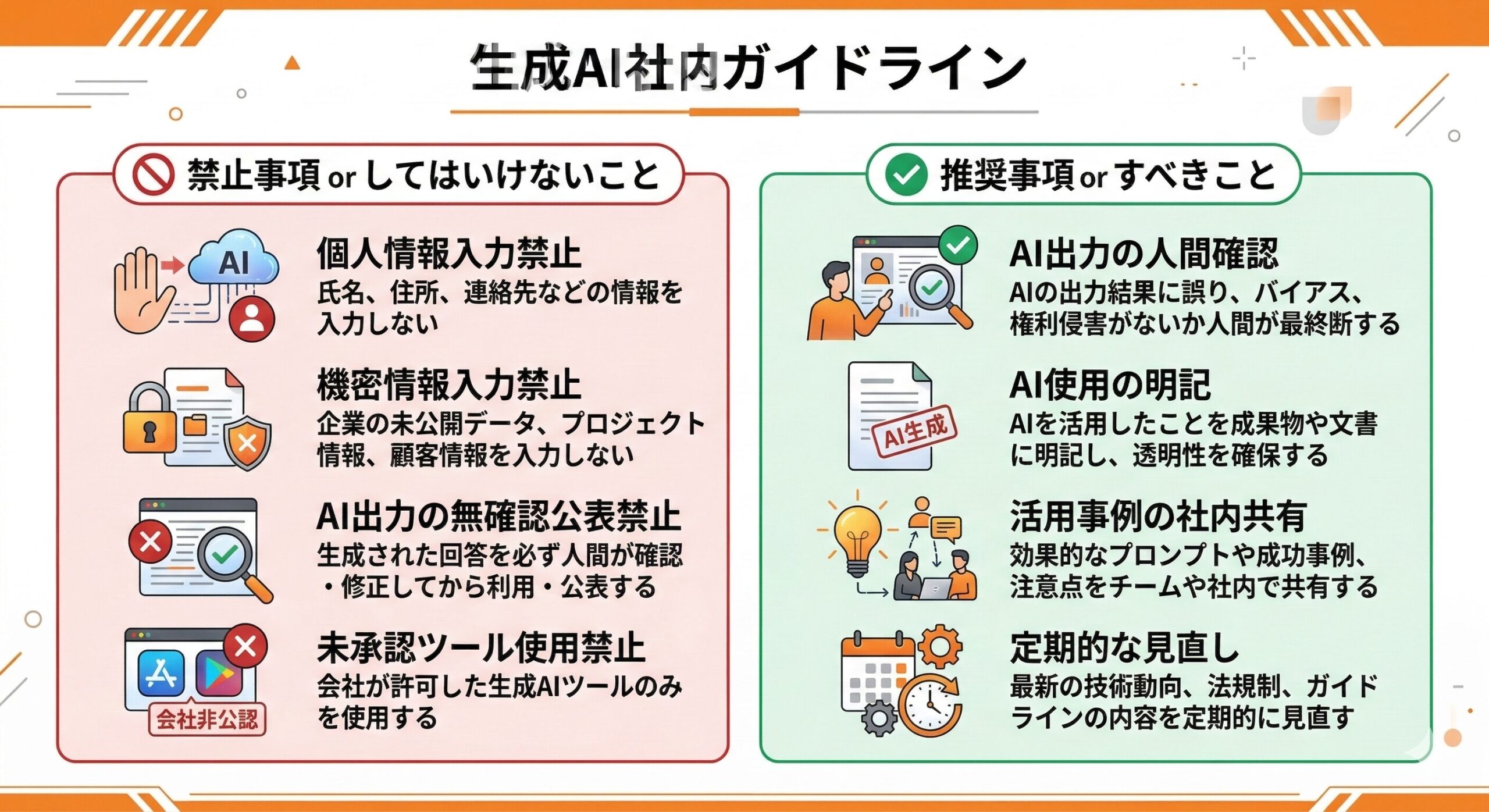

生成AI社内ガイドライン:必須項目と解説

必須項目①:対象範囲・適用ルール

ガイドラインが誰に、どのAIツールに適用されるかを明確にします。

【記載例】

本ガイドラインは、○○株式会社の全従業員(正社員・契約社員・派遣社員・業務委託)に適用されます。対象となるAIツールは以下のとおりです。

【承認済みAIツール一覧(例)】

✅ ChatGPT Enterprise(社内プロジェクト向け)

✅ Microsoft Copilot(Office業務向け)

✅ GitHub Copilot(エンジニア向け)

【未承認・原則禁止ツール】

❌ ChatGPT 無料版・Plus版(個人アカウント)での業務利用

❌ 承認されていないAIサービス全般必須項目②:入力禁止情報の定義

AIへの入力を禁止する情報を具体的にリスト化します。これが生成AI社内ルールの中核をなす部分です。

【AIへの入力禁止情報リスト(テンプレート)】

個人情報・機密情報:

❌ 顧客・取引先の氏名・住所・電話番号・メールアドレス

❌ マイナンバー・社会保障番号・パスポート番号

❌ 社員の人事情報・評価データ・給与情報

❌ 患者情報・医療記録(医療機関の場合)

事業機密・知的財産:

❌ 未公開の製品開発情報・特許出願予定の技術

❌ M&A・資本提携に関する情報

❌ 未公開の財務情報・予算計画

❌ 競合分析・価格戦略に関する機密情報

法的リスク情報:

❌ 訴訟・法的係争中の案件に関する情報

❌ コンプライアンス違反の可能性がある情報必須項目③:AI生成物の利用ルール

【AI生成物の利用ルール(テンプレート)】

ファクトチェック義務:

□ AI生成の数値・統計・引用は必ず一次情報源で確認する

□ 法律・規制に関する情報は法務部門または外部専門家に確認する

□ AIが提示した参考文献・URLが実在するか確認する

著作権確認:

□ AI生成画像を商用利用する場合、利用するAIサービスの利用規約を確認する

□ IP補償対象外のサービスで生成した画像の商用利用は法務に確認する

開示義務:

□ AI生成コンテンツを外部公開する場合、必要に応じてAI利用を開示する

□ 社外向け文書でAI生成物をそのまま使用する場合は上長承認を得る必須項目④:インシデント対応フロー

| インシデント種別 | 初動対応 | 報告先 | 対応期限 |

|---|---|---|---|

| 機密情報の誤入力 | 利用停止・AI事業者への削除依頼 | 情報システム部・法務 | 発覚後24時間以内 |

| AI生成コンテンツでの著作権問題 | 該当コンテンツの公開停止 | 法務・広報 | 発覚後48時間以内 |

| ハルシネーションによる誤情報拡散 | 訂正情報の発信・関係者への連絡 | 広報・当該部門長 | 発覚後速やかに |

業種別:生成AIガイドラインのポイント

| 業種 | 特有のリスク | 追加すべき項目 |

|---|---|---|

| 金融・保険 | 顧客金融情報・投資情報の漏洩 | 金融規制当局ガイドラインへの準拠、顧客情報の厳格な入力禁止 |

| 医療・介護 | 患者情報・医療記録の漏洩 | 要配慮個人情報の特別管理、医師法・薬機法との整合 |

| 法律・会計 | 守秘義務対象情報の漏洩 | 守秘義務情報の入力禁止、資格倫理規定との整合 |

| 製造 | 設計情報・特許の漏洩 | 技術情報の分類と入力可否基準の明確化 |

| 広告・メディア | 著作権・AI開示義務 | クライアント承認プロセス、AI生成コンテンツの開示方針 |

生成AIガイドライン策定後の周知・教育

ガイドラインは策定して終わりではありません。全従業員への浸透が不可欠です。生成AIリテラシー教育の進め方と合わせて、以下の施策を実施してください。

- 全従業員向け必修eラーニング(30分〜1時間):ガイドラインの要点・禁止事項・インシデント報告方法

- ポスター・デスクチェックシートの配布:入力禁止情報リストを目の届く場所に掲示

- 部門別Q&Aセッション:各部門の実態に即した質疑応答で理解を深める

- 管理職向け追加研修:部下への指導方法・インシデント対応の実践

社内ガイドライン策定の参考資料として、公的機関の指針を活用しましょう。経済産業省「AI事業者ガイドライン」は国内企業向けの包括的なガイドラインであり、内閣府AI戦略も企業のAI活用指針として参考になります。

よくある質問(FAQ)

Q. 中小企業でも生成AIガイドラインは必要ですか?

はい、従業員が生成AIを使い始めたなら規模に関わらず必要です。中小企業では大企業ほど詳細なガイドラインは不要ですが、①入力禁止情報リスト、②承認済みツール一覧、③ファクトチェック義務の3点を最低限定めるだけでも大きなリスク低減になります。

Q. ガイドライン策定にどれくらいの時間がかかりますか?

最小限のガイドラインであれば2〜4週間で策定可能です。大企業で法務・IT・各事業部を巻き込む場合は2〜3ヶ月を見込んでください。まず「暫定版」を1ヶ月で作って運用開始し、フィードバックを受けて改訂する方法が現実的です。

Q. 既存の情報セキュリティポリシーと別に作るべきですか?

既存の情報セキュリティポリシーの「付属文書」として生成AI利用規程を追加する形が一般的です。これにより既存のポリシー体系との整合性を保ちながら、生成AI固有のルールを追加できます。

Q. 従業員がガイドラインに違反した場合の処罰規定は必要ですか?

就業規則・情報セキュリティポリシーに基づく懲戒規定が適用されることを明記するのが一般的です。ただし、最初から罰則を前面に出すより、「なぜルールが必要か」の理解促進と報告しやすい雰囲気づくりが重要です。

まとめ

生成AI ガイドラインの策定は、現状調査→リスク評価→ガイドライン案策定→承認・周知→定期見直しの5ステップで進めましょう。必須項目である入力禁止情報・承認ツール・AI生成物利用ルール・インシデント対応フローをテンプレートとして活用してください。

ガイドライン策定の土台となるAIリテラシー完全ガイドや、法的側面を理解するための生成AIと法律のガイドもあわせてご覧ください。

コメント