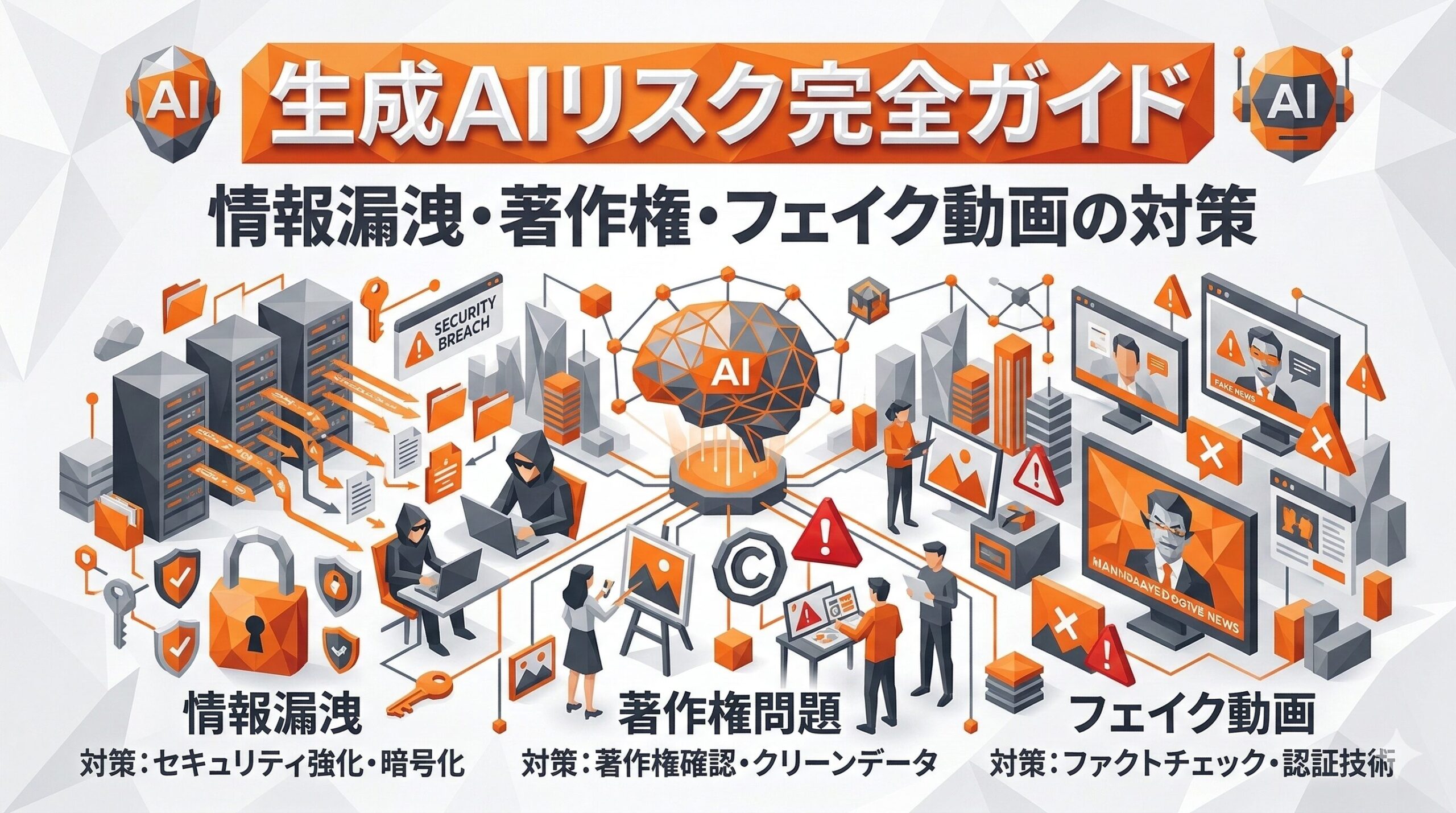

生成AIの業務活用が急拡大する一方で、生成AIリスクに関するトラブルも急増しています。情報漏洩・著作権侵害・ハルシネーション(誤情報)・AIフェイク動画など、企業が直面するリスクは多岐にわたります。本記事では生成AIリスクの全体像と具体的な対策を解説します。

生成AIリスクの7つのカテゴリ

生成AI リスクは大きく7つのカテゴリに分類できます。自社に関連するリスクを把握することが対策の第一歩です。

| リスクカテゴリ | 具体例 | 影響度 |

|---|---|---|

| 情報漏洩リスク | 機密情報・個人情報をAIに入力 | ★★★★★ |

| 著作権リスク | AI生成物の商用利用・学習データの権利問題 | ★★★★☆ |

| ハルシネーション | AIが誤情報を生成・事実と異なる回答 | ★★★★☆ |

| フェイク動画・ディープフェイク | なりすまし・企業ブランドの毀損 | ★★★★★ |

| プロンプトインジェクション | 悪意あるプロンプトによるシステム操作 | ★★★☆☆ |

| バイアス・差別 | AIが特定のグループに不公平な判断 | ★★★☆☆ |

| 依存・スキル低下 | AIへの過度な依存による人間スキルの劣化 | ★★☆☆☆ |

リスク①:生成AIによる情報漏洩

生成AI情報漏洩は企業にとって最も深刻なリスクです。2023年、Samsung社員がChatGPTにソースコードを入力し、機密情報がOpenAIのサーバーに送信される事故が発生しました。同様の事例は日本でも増加しています。

情報漏洩の主な経路

- 会話ログの学習利用:無料・個人利用版のChatGPTでは会話が学習データになる可能性

- クラウドサーバーへの送信:入力情報は一時的にOpenAI等のサーバーに保存される

- サードパーティ連携:ChatGPTプラグインや外部サービスとの連携による漏洩

- スクリーンショット・共有:会話内容の意図しない共有・スクリーンショット

情報漏洩対策

【入力禁止情報リスト(例)】

❌ 顧客の個人情報(氏名・住所・連絡先・マイナンバー)

❌ 未公開の財務情報・決算データ

❌ 開発中の製品情報・特許出願前の技術

❌ 社内の人事情報・評価データ

❌ 競合分析・M&A関連の機密情報

❌ 法的に係争中の案件に関する情報

【安全な利用方法】

✅ ChatGPT Enterprise(データ学習オフ)を使用

✅ APIを通じた利用(デフォルトでデータ学習なし)

✅ 自社環境に構築したプライベートAIを使用

✅ 情報の匿名化・仮名化処理後に入力リスク②:著作権侵害リスク

生成AIによる著作権問題は法的にグレーゾーンが多く、注意が必要です。日本の著作権法では2018年の改正により、AIの学習目的での著作物の複製は原則として許容されていますが、利用段階での権利侵害は別問題です。

著作権リスクが高い場面

- 画像生成AIの商用利用:特定アーティストのスタイルを模倣した画像の商用利用

- 文章の大量生成・コピー:既存コンテンツに類似した文章の生成と公開

- 音楽・映像生成:既存楽曲・映像に類似したコンテンツの生成

- コードの商用利用:GitHubのコードを学習したAIが生成するコードの権利問題

著作権リスク対策

Adobe Fireflyのようにロイヤリティフリーのデータで学習し、IP補償(インデムニフィケーション)を提供するサービスの活用が企業の著作権リスク低減に有効です。ただしIP補償はCreative Cloud Pro Plus・Enterpriseプランのみ対象です。

リスク③:ハルシネーション(誤情報生成)

ハルシネーションとは、生成AIがもっともらしい誤情報を出力する現象です。これは生成AIの構造上避けられない問題であり、最新モデルでも発生します。

| ハルシネーションが起きやすい場面 | リスク | 対策 |

|---|---|---|

| 最新情報の質問(2023年以降など) | 古い・存在しない情報を提示 | 知識カットオフの確認・検索ツール利用 |

| 法律・医療・財務の専門的質問 | 誤った専門的アドバイス | 専門家への確認を必須化 |

| 引用・参考文献の生成 | 存在しない論文・URLを提示 | 必ず一次情報源を確認 |

| 数値計算・統計 | 誤った計算・数値の生成 | 実際の計算で検証 |

リスク④:AIフェイク動画・ディープフェイク

AIフェイク動画(ディープフェイク)技術は急速に高度化しており、企業・個人の両方に深刻なリスクをもたらしています。詳細な対策についてはディープフェイク対策完全ガイドをご覧ください。

企業へのAIフェイク動画リスク

- CEOなりすまし詐欺:経営者の声・顔を偽装した振り込め詐欺(2024年に複数の国際事例発生)

- ブランド毀損:企業の公式動画と見間違う偽動画の拡散

- 社員へのなりすまし:採用プロセスでのディープフェイク利用

- SNSでの虚偽情報拡散:企業に不利益な偽動画の意図的拡散

リスク⑤:プロンプトインジェクション攻撃

プロンプトインジェクションとは、悪意あるユーザーがAIシステムへの入力に隠れた命令を埋め込み、意図しない動作を引き起させるサイバー攻撃の一種です。AIを業務システムに統合する際に特に注意が必要です。

【プロンプトインジェクション対策】

• 入力値の検証・サニタイズ処理を実装

• システムプロンプトとユーザー入力を明確に分離

• AIが実行できるアクションに制限を設ける

• 異常な動作を検知する監視システムを導入

• 定期的なペネトレーションテストの実施生成AIリスク管理の実践的フレームワーク

企業が生成AIリスクを体系的に管理するためのフレームワークを紹介します。社内ガイドライン策定マニュアルと合わせて活用してください。

| フェーズ | アクション | 担当 |

|---|---|---|

| リスク特定 | 業務での生成AI利用シーンを洗い出し、各シーンのリスクを評価 | 情報システム部・法務 |

| ポリシー策定 | 利用可能ツール・入力禁止情報・ファクトチェック手順を文書化 | 経営企画・法務 |

| 教育実施 | 全従業員へのAIリテラシー基礎研修・部門別実践研修 | 人事・情報システム部 |

| モニタリング | AI利用ログの定期確認・インシデント報告・ポリシーの定期見直し | 情報システム部 |

| インシデント対応 | 情報漏洩等のトラブル発生時の対応フロー整備 | 法務・広報・経営 |

生成AIリスク対策に関する公的機関のガイドラインも参考にしてください。個人情報保護委員会ガイドラインや経済産業省AI原則・ガバナンスは、企業のAIリスク管理の基準として広く参照されています。

よくある質問(FAQ)

Q. 従業員がChatGPTを個人のスマホで使う場合もリスクがありますか?

はい、業務情報を個人端末の個人アカウントで使用する場合、会社の管理が及ばないためリスクはむしろ高まります。個人デバイスでの業務情報入力を禁止するBYODポリシーと、AIツール利用ポリシーを合わせて整備することが必要です。

Q. 生成AIのリスクと、クラウドサービスのリスクはどう違いますか?

クラウドサービス(Google Drive・Slackなど)はデータをサーバーに保存する点で同様ですが、生成AIには「学習データへの利用リスク」「ハルシネーション」「プロンプトインジェクション」など固有のリスクがあります。AIリスクはクラウドリスクに加えて追加的に管理が必要です。

Q. AIを使った詐欺被害に遭った場合、法的手段はありますか?

AIを使った詐欺(CEOなりすまし等)は従来の詐欺罪・不正競争防止法等の法律が適用されます。また、不正な目的でのディープフェイク生成は各国で規制が進んでいます。日本では2025年に向けて法整備が議論されています。詳しくは生成AIと法律のガイドをご覧ください。

まとめ

生成AI リスクを正しく理解し対策を講じることが、安全で効果的なAI活用の前提条件です。情報漏洩・著作権・ハルシネーション・フェイク動画の4大リスクを中心に、会社の規模や業種に応じた適切なリスク管理体制を構築しましょう。

生成AIリスク管理の基盤となるAIリテラシー完全ガイドや、具体的な対策の社内ガイドライン策定マニュアルもあわせてご覧ください。

コメント